بسم الله الرحمن الرحیم

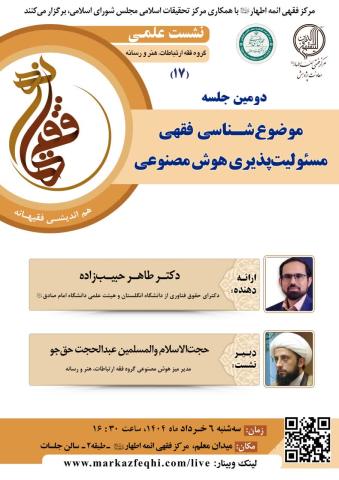

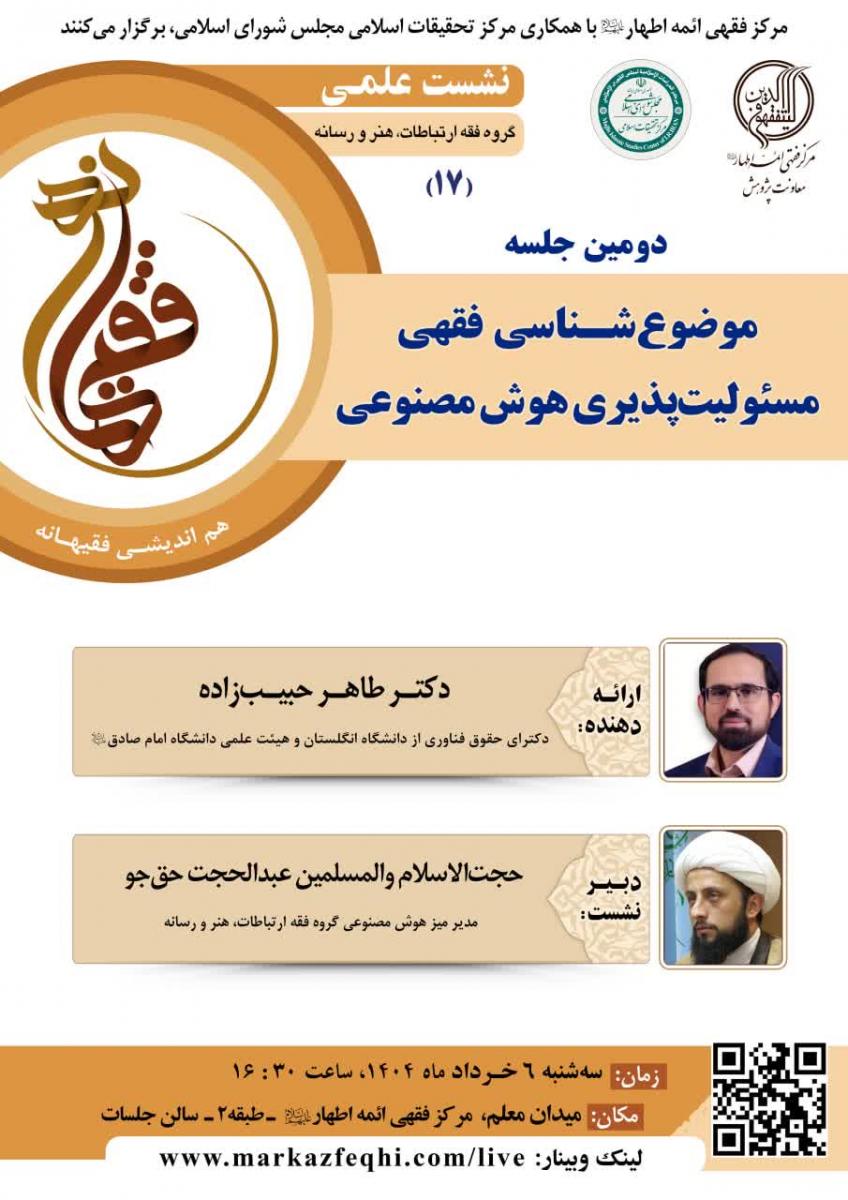

جلسه دوم موضوع شناسی فقهی مسؤلیت پذیری هوش مصنوعی با همت گروه فقه، رسانه و ارتباطات (میز پژوهشی فقه، فناوری و هوش مصنوعی) و با همکاری مرکز تحقیقات اسلامی مجلس و با حضور دانش پژوهان در سالن جلسات مجتمع فقهی ائمه اطهار (علیهم السلام) برگزار شد.

در این نشست دکتر طاهر حبیب زاده دکترای حقوق فناوری از دانشگاه انگلستان و عضو هیئت علمی دانشگاه امام صادق علیه السلام مقدمهای از مباحث گذشته ارائه نموده و گفت: عنوان بحث مسئولیت پذیری هوش مصنوعی بود و به عنوان مقدمه میگوئیم عوامل مسئولیت آفرین باید از عوامل مسئولیت پذیر جدا شوند که عوامل مسئولیت آفرین لزوما شخصیت حقوقی ندارند. طبق یک قاعده عقلی در حقوق میگویند هیچ ضرری نباید بدون پاسخ بماند اما به این شرط که قدرت بر استیفا داشته باشیم مانند اینکه در مورد خدای متعال و قدرت قاهره از لحاظ حقوق گفته میشود که نمیتوان احقاق حقوق کرد.

در مورد هوش مصنوعی نیز مسئله مسئولیت آفرینی مطرح میشود اما سوال این است که آیا مسئولیت پذیری نیز در مورد هوش مصنوعی جریان دارد یا خیر؟! اگر بگوئیم دارای شخصیت است مسئله واضح میشود اما اگر شخصیت نداشته باشد باید دید چگونه مسئولیت پذیری ممکن میشود؟ البته امکان دارد مبدع با مالک متفاوت باشد و این مسئله از لحاظ حقوقی کاملا پذیرفته شدهاست.

در حقوق ایران این نکته مورد اشاره قرار گرفت که شخصیت را حقوقی، اعتباری و سیستم رایانهای خودکار شدند. این مسئله یعنی سیستمهای هوش مصنوعی در کنوانسیونهای بین المللی (ترجمه کنوانسیون 1404) به صورت مشخص تعریف شده و خودمختاری در مورد آن ذکر و خودکاری در مورد آن نفی شدهاست. با تعریفی که در قانون ما ذکر شده قطعا هوش مصنوعی دارای شخصیت است.

بحث جدید این است که اگر وفادار به قانون باشیم هر چند غلط باید آنرا رعایت کنیم چون ایجاد هرج و مرج میشود پس طبق این قانون باید گفت هوش مصنوعی شخصیت دارد در حالیکه غیر از آفریقای جنوبی هیچ کشوری این مسئله را قبول ندارد. اگر تشخص هوش مصنوعی را قبول کردیم آیا مطلق مسئولیت بر عهده او است؟ برخی میگویند هوش مصنوعی معصوم است حال باید دید از نحوه عملکرد باید بررسی شود یا در مورد خروجی؟ از نظر فنی هوش مصنوعی معصوم است اما از لحاظ خروجی باید دید چه ورودی به او داده میشود؟

ضمن اینکه باید دید آیا خالق هوش مصنوعی در کارهایی که او هر چند به صورت مستقل انجام میدهد وظیفه و ضمان دارد یا خیر؟! به بیان دیگر آیا هوش مصنوعی به صورت مطلق مسئول است یا توسعه دهنده آن نیز مسئولیتی دارد؟ نظریه مسئولیت به اندازه کنترل که اصطیادی است میگوید اگر صغیر یا محجور خسارتی وارد کرده باشد (1126) ضامن است یا ماده 7 قانونی مدنی میگوید اگر صغیر تحت مراقبت کننده بود و صغیر ایجاد مشکل کرد آن مراقبت کننده ضامن است چون مسئولیت را بدرستی انجام ندادهاست. یا اگر شخصی بر یک سگ کنترل داشت یا سگ ولگرد که مسئولیت آن به عهده حکومت است خسارتی وارد کرد باید توسط آن فرد یا بیت المال جبران شود. در مورد هوش مصنوعی نیز میتوان گفت چون توسعه دهنده بر پلتفرم مبتنی بر هوش مصنوعی یا خود هوش مصنوعی کنترل داشته و مسئولیتش را بدرستی انجام نداده پس میتواند مسئولیت باشد.

اگر شخصیت برای هوش مصنوعی قائل نشویم کاربر به انداز خطایی که انجام داده و توسعه دهنده به اندازه کنترلی که دارد مسئولیت بر عهده دارند. مسئله دیگر این است که دولتها هم در این مسئله مسئولیت دارند چون کنترل بر این فضا برای آنها امکان دارد اما این مسئله به صورت مطلق نیست چون گاهی اوقات فیلترینگ انجام میشود اما با فیلترشکن مردم دسترسی پیدا میکنند. در هر صورت میتوان گفت حاکمیت قبل از رشد این پلتفرمها میتواند پیش دستی کرده و راه را ببندد.

در ادبیات حقوقی گفته شد هوش مصنوعی باید دارای شخصیت باشد تا مسئولیت پذیر شود اما در ادبیات فقهی باید دید کدام موجودات دارای استعداد برخورداری از حقوق را دارند؟!

در فقه قاعده مشخصی برای اینکه یک مفهوم دارای شخصیت طبق تعبیر حقوقی شود وجود ندارد اما یکی نهادهایی که میتواند دارای حقوق شود کعبه، مساجد، معابد، مدارس، مکتبخانه و... است. شیخ طوسی پلها و استراحتگاهها نیز میتوانند شخصیت داشته باشند. همچنین سید در عروه میفرماید زکات نیز میتواند شخصیت پیدا کند و پولی را از نهاد زکات خرج کند و دوباره به آن بازگرداند.

در حال حاضر میتوان گفت در مورد تشخیص این قبیل شخصیتها بنای و سیره عقلاء معیار بوده و عقد آن ضرورت دارد و همین مسئله در فقه نیز جاری شدهاست اما اشکال این است که اولاً مشخص نیست مقصود از عقلاء کیست و در مورد این موضوع خاص یعنی هوش مصنوعی نظر چه کسی به عنوان عقلاء باید مطرح شود چون مثلاً در اتحادیه اروپا یک پیش نویس نوشته شده و در آن هوش مصنوعی را دارای شخصیت دانستند اما در ادامه تعداد زیادی از متخصصان این مسئله در علوم مختلف طی نامهای خواهان نفی آن شدند و این مسئله از پیشنویس حذف شد.